只包含查询语法, 不包含具体机制.

BERT 复习

复习

- Devlin, J., Chang, M.-W., Lee, K., & Toutanova, K. (2018). Bert: Pre-training of deep bidirectional transformers for language understanding. arXiv Preprint arXiv:1810.04805.

文档目录抽取

文档结构化是很暧昧的词, 它可能的意思很多, 不过本文只考虑目录抽取.

结构化文档由各级章节标题和段落等逻辑结构组成, 比如对 HTML 来说, 逻辑结构包括 <body> <h1> <p> 等标签. 文档结构化任务基本等价于目录抽取, 因为识别出标题后剩下的就是段落. 这个领域可供搜索的关键词包括 document structure recognition, document layout analysis (版面分析) 等. 意义: 便于抽取信息, 高度定制化的展示等.

Transformer 复习

复习

- Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., Kaiser, Ł., & Polosukhin, I. (2017). Attention is all you need. Advances in Neural Information Processing Systems, 5998–6008.

[半监督] 非监督数据增强 (UDA)

来自 Google 的

- Xie, Q., Dai, Z., Hovy, E., Luong, M.-T., & Le, Q. V. (2019). Unsupervised data augmentation for consistency training. arXiv Preprint arXiv:1904.12848. [Code] [Code for PyTorch]

Consistency training methods simply regularize model predictions to be invariant to small noise applied to either input examples or hidden states. This framework makes sense intuitively because a good model should be robust to any small change in an input example or hidden states.

图神经网络简介

主要参考

- Hamilton, W. L. (2020). Graph representation learning. Synthesis Lectures on Artifical Intelligence and Machine Learning, 14(3), 1-159.

一本只有 140 页的综述小册子. 本文主要基于第 5-6 章, 简要介绍图神经网络, 不涉及生成式 GNN 等内容.

《理解漫画》笔记

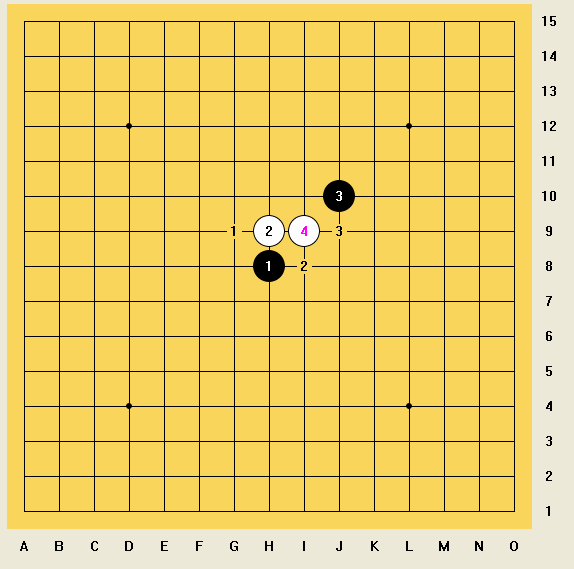

五子棋复盘: 初心者

难得下一次棋, 水平没啥进步. 默认是五林上的对局.

疏星简要

最常见的是前三打: 一打偏黑, 二打平衡略偏白, 三打白小优 (结论出自 2021/9/13 漱星阁的索索夫规则开局指南). 分支太多了, 只看前几手.

参考 KataGo 和

- haisarenjuthink. (2020, Mar 26). 五目クエスト攻略~疎星の打ち方~. 連珠雑記.

- 疏星二打总谱

- 疏星三打总谱

棋谱的记号完全不明白.

Python 杂录 2: 最佳实践

由于历史遗留原因, 第一篇 Python 杂录 放在了 Language 类别下. 第二篇 Python 杂录更偏重 best practices.